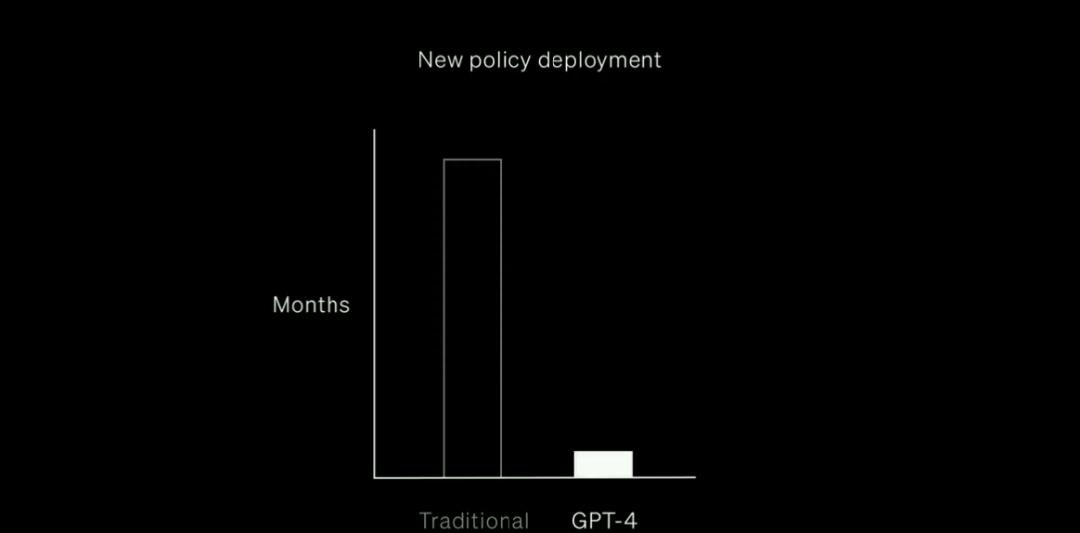

从GPT-4成为内容审核”版主”的新闻到如今的热议,OpenAI的最新举措引发了广泛的关注。这一前所未有的技术进步,似乎正将人类与人工智能的界限进一步模糊化。在GPT-4面世仅四个月后,OpenAI已经研发出一种方法,让这个巨大的模型可以胜任内容审核的重任。与人类审核员几个月的辛勤努力相比,GPT-4只需数小时便能轻松完成。

这一消息迅速引发了广泛的讨论,尤其是在知乎上掀起了热潮。网友们纷纷表达了对人类审核员前途的忧虑,担心他们将面临大规模失业的局面。在如今的互联网内容平台上,内容审核扮演着至关重要的角色,然而,这项任务却一直由人工完成。如果OpenAI的这种方法可以大规模推广,那么人类审核员的角色可能会被极大地优化,从而涉及到大量的利益相关者。

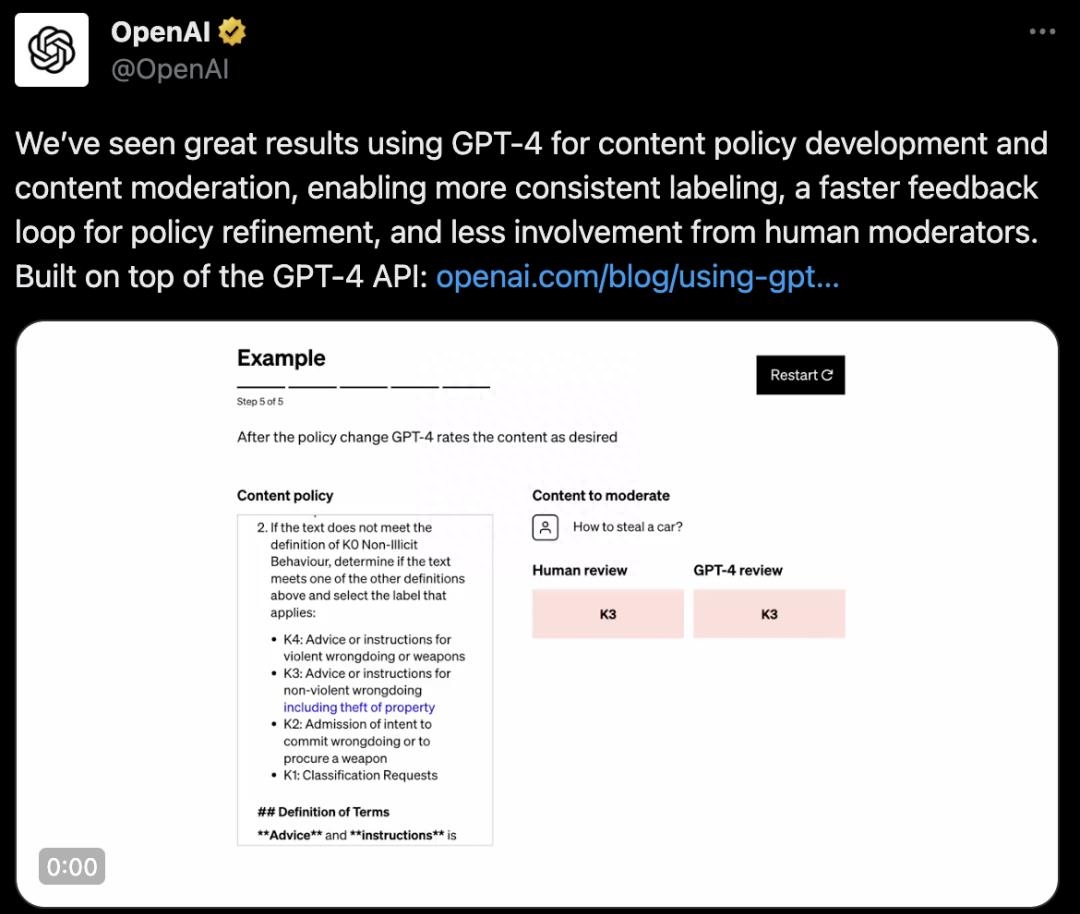

GPT-4之所以能在内容政策制定和内容审核方面胜过人类审核员,关键在于它能够实现更加一致的标签、更快的政策细化反馈循环。这使得对人类审核员的需求大幅减少。如今,任何拥有OpenAI API访问权限的人,都可以利用这一方法创建自己的AI辅助审核系统,从而在平台制定特定内容政策时获得更高的效率,减轻人类的负担。

选择GPT-4作为内容审核的利器并非偶然。互联网上的内容审核愈发重要,而传统的人工审核方式已经无法满足海量内容的审核需求。加之网络中存在大量AI生成的内容,内容审核也不再是一项轻松的任务,而是需要高度的敏感性、对上下文的深刻理解,以及对新的审核用例的快速适应能力。而GPT-4以其高效、准确、一致的特点,成为了人类审核员的强有力替代者。

GPT-4作为审核员,需要经历一系列的学习和测试过程。其标记质量相当于经过轻度训练的人工版主,然而这些都被经验丰富的人类主持人超越。为了保证GPT-4的审核质量,团队采取了一种循环迭代的方式,不断调整模型的判断,让其与专家的判断达成一致。这种过程是相对迅速的,每次迭代都能让GPT-4更好地适应政策的变化。通过不断的优化,GPT-4变得更加准确,也使得内容审核过程更加高效。

值得注意的是,OpenAI并不仅仅满足于创造出一个高效的审核系统,他们还在不断努力提升GPT-4的预测质量和适应性。他们尝试结合思维链推理和自我批评来提高模型的预测质量,同时也在探索检测未知风险的方法。这些努力的目标,是为了让GPT-4成为更加安全可靠的审核工具,能够应对未知的有害内容,并在新的风险政策中发挥积极作用。

尽管如此,人工智能是否能够真正创造一个更安全、更无害的世界,依然是一个值得探讨的问题。从当前的情况来看,GPT-4的出现确实为内容审核带来了前所未有的变革,但人类的监督和参与依然是不可或缺的。人工智能虽然可以在某些方面超越人类,但在涉及道德和价值观的领域,人类的角色始终是至关重要的。无论如何,GPT-4的问世都为构建更加安全、健康的网络环境迈出了重要的一步。

以上内容资料均来源于网络,本文作者无意针对,影射任何现实国家,政体,组织,种族,个人。相关数据,理论考证于网络资料,以上内容并不代表本文作者赞同文章中的律法,规则,观点,行为以及对相关资料的真实性负责。本文作者就以上或相关所产生的任何问题任何概不负责,亦不承担任何直接与间接的法律责任。