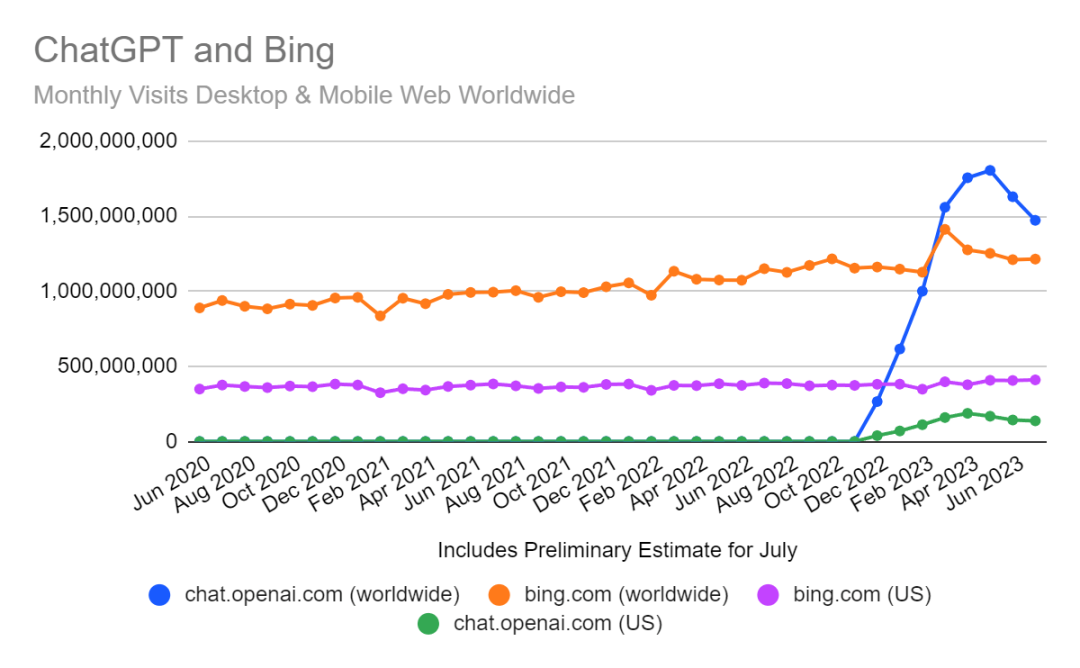

继 6 月流量首次下降了 9.7% 后,根据网站数据分析工具 SimilarWeb 最新调查显示,ChatGPT 出现了连续第二个月的下降:7 月其流量又下降了 9.6%。

ChatGPT 访问量下降的背后原因,SimilarWeb 猜测可能与学生放假有关。但除此之外,似乎越来越多企业也开始决定禁用 ChatGPT,不仅包括三星和苹果,此前摩根大通、德意志银行、Verizon 和亚马逊等公司也限制员工使用 ChatGPT。

而本周,黑莓公司(BlackBerry)又发布了一项最新研究:

▶ 目前全球有 75% 的组织,正考虑禁止在工作场所使用 ChatGPT 和其他生成式 AI 应用。

▶ 61% 正在部署或考虑 ChatGPT 禁令的公司表示,禁用 ChatGPT 的措施将是长期或永久性的。

为什么企业要禁用 ChatGPT?

根据黑莓官方博客介绍,该研究数据源自其对美国、加拿大、英国、法国、德国、荷兰、日本和澳大利亚等国家近 2000 名 IT 决策者的调查。

调查结果显示,推动 ChatGPT 和生成式 AI 禁令的,多是企业内部的技术领导层,另外近一半企业的首席执行官也发挥着主导作用:

▶ CIO(首席信息官)/ CTO(首席技术官)/ CSO(首席安全官) / IT——72%

▶ CEO(首席执行官)——48%

▶ 法律合规管理者——40%

▶ CFO(首席财务官)/ 财务——36%

▶ HR(人力资源)——32%

反对企业在工作场景使用 ChatGPT 的理由有很多,约有 67% 的受访者认为 ChatGPT 可能带来的数据安全和隐私问题是最大风险,其次企业的声誉风险也是 57% 的人考虑禁用 ChatGPT 的原因之一。

实际上早在今年 3 月,黑莓曾就“组织使用 ChatGPT 安全吗?”这个话题,咨询了公司内部的几位安全专家,以此揭示每个组织在使用 ChatGPT 或类似工具时应该注意的事情,大体来说可分为三个方面:

(1)AI 聊天机器人的数据泄漏和安全问题

如果将敏感的第三方或公司内部信息输入 ChatGPT,这些信息将成为其训练数据的一部分,并可能与提出相关问题的其他人共享,从而导致数据泄漏。任何未经授权向 ChatGPT 披露机密信息的行为,都可能违反企业的安全政策。

(2)使用 AI 聊天机器人的法律考量因素

一旦 ChatGPT 的安全性受到破坏,原本根据合同或法律应保护的内容就可能会被泄露,并归咎于组织,从而影响公司的声誉。另外,如果用 ChatGPT 生成代码,其版权归谁所有很难界定;用 ChatGPT 生成受版权保护的书面材料,如授权的开源材料等,也会产生版权问题,甚至可能会使公司违反 OSS(开源软件)许可。

还有一点很重要:服务条款规定,ChatGPT 不得用于开发任何其他 AI。如果你所在公司也处于 AI 领域的话,使用 ChatGPT 就可能危及未来公司的 AI 开发。

(3)AI 聊天机器人的隐私注意事项

ChatGPT 一直警告用户,不要提供或输入敏感个人信息,如姓名或电子邮件地址等。向 AI 生成系统提供任何个人数据都可能被重新用于其他目的,从而导致滥用和声誉受损,并可能违反组织对员工、客户和合作伙伴的隐私承诺。

尽管使用 ChatGPT 带来的风险不小,不少 IT 决策者也倾向于阻止这一新兴技术的广泛使用,但同时他们也承认生成式 AI 应用在工作场所会产生积极影响:55% 的人认为生成式 AI 有助于提高工作效率,52% 的人认为其有助于创新,51% 的人认为可以增强创造力。此外,当谈到使用生成式 AI 工具进行网络安全防御时,大多数受访者(81%)也都非常赞成。

建议采取“谨慎而积极”的态度

不仅如此,黑莓的研究数据还显示,尽管 80% 的 IT 决策者认为企业有权控制员工用于业务目的的应用程序,但同时也有 74% 的人认为这种禁令是对企业和办公设备的“过度控制”。

为此,不少受访的首席信息官和首席信息安全官(62%)表示,其公司内部已转向统一端点管理(UEM)平台,即可对哪些应用可以连接到企业环境进行细粒度控制,通过这种方式将员工的私人数据或应用进行分开和隔离,同时又能确保企业安全得到维护。

基于以上使用 ChatGPT 等生成式 AI 的利与弊,黑莓公司网络安全首席技术官 Shishir Singh 呼吁,各个企业和组织应采取“谨慎而积极”的态度:“禁止在工作场所使用生成式 AI 应用,可能意味着大量潜在的商业利益被扼杀。”

Shishir Singh 强调,随着未来 AI 平台的逐渐成熟和相关法规的生效,企业可能会采取灵活性政策,其中的关键还是在于:对工作场所使用的生成式 AI 应用,要有合适的工具对其进行可见性的监控和管理。

网友:因为不了解 AI,所以要放弃 AI?

对于黑莓提供的这份调查报告,不少网友的第一反应是“黑莓居然还活着呢?”,随后便开始了激烈的讨论:

▶“禁止在这些聊天机器人上透露敏感数据我可以理解,但全面禁止似乎太过分了吧?”

▶“如果我是公司负责人,我也会禁止这些面向公众的模型,毕竟数据被盗的风险太大了,尤其是在使用插件等东西的情况下。”

▶“我所在的公司也很快就下达了禁令,但不是全面禁令,我只是不能在提示中输入任何识别信息或敏感信息,对于一般的内容,公司没做限制。”

除了对禁止使用 ChatGPT 这一行为做出讨论,部分网友认为企业做出这个决定的根本原因,并不是因为 AI 技术有危险,而是“人类不了解如何正确使用工具”:

▶ “这有道理,但根本来说并不是因为技术有危险,而是因为人类不了解如何正确使用工具。正如我们历史上的大多数时代一样,我们会害怕我们不了解的东西——这基本上意味着,在我们想出办法之前,我们只会试图将其抛弃,正如这次的生成式 AI。 ”

那么,你所在公司是否允许员工使用生成式 AI 工具?你对于企业禁用生成式 AI 工具又有何看法?