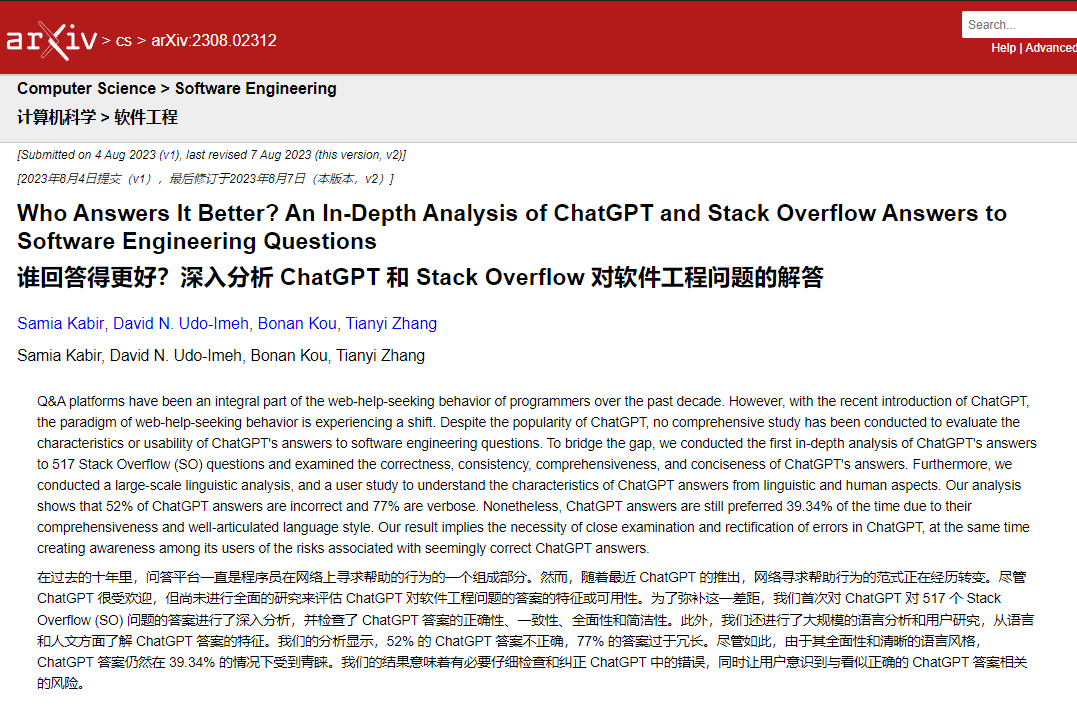

IT之家 8 月 8 日消息,美国普渡大学的研究发现,OpenAI 开发的人工智能聊天机器人 ChatGPT 在回答软件编程问题时,错误率超过一半,但仍能骗过三分之一的提问者。

该研究团队分析了 ChatGPT 对 517 个 Stack Overflow 网站上的问题的回答,评估了其正确性、一致性、全面性和简洁性。他们还对回答进行了语言和情感分析,并对 12 名志愿参与者进行了问卷调查。研究报告的结论是:ChatGPT 的回答虽然语言风格良好,但 52% 的回答是错误的,77% 是冗长的。参与者只有在回答中的错误很明显时,才能识别出来。否则,他们会被 ChatGPT 的友好、权威和细致的语言风格所误导。

Stack Overflow 是一个专门为程序员提供问答服务的网站,被认为是开发者获取代码片段和解决问题的重要来源。然而,该网站近年来也面临着流量下降、内容质量下降和用户信任下降等问题。据 SimilarWeb 在 4 月份的一份报告显示,自 2022 年 1 月以来,该网站每月流量下降了 6%,3 月份下降了 13.9%,而 ChatGPT 可能是导致其流量下降的原因之一。Stack Overflow 则否认了 SimilarWeb 的评估,并表示其流量受到搜索算法和 ChatGPT 兴趣激增的影响。

OpenAI 在其 ChatGPT 网站上承认其软件“可能会产生关于人、地点或事实的不准确信息。”截至IT之家发稿,该公司暂未对普渡大学的研究作出回应。