不希望网站数据被ChatGPT白嫖?现在终于有办法了!

两行代码就能搞定,而且是OpenAI官方公布的那种。

刚刚,OpenAI在用户文档中更新了GPTBot的说明。

根据这一说明,内容拥有者将可以拒绝网站数据被ChatGPT的爬虫抓取。

这是继暂停网页访问功能之后,OpenAI在版权和隐私保护方面的又一重大举措。

不过,OpenAI还是希望能内容拥有者将访问权限开放给GPTBot。

在这份关于GPTBot的说明中,OpenAI表示:

允许我们的爬虫访问你的数据有利于使AI模型更精确、更安全。

但至少,站主们拥有了选择的权利。

不过,也有网友指出了问题:

模型早就已经训练好了,现在提这个还有什么用?

对此OpenAI尚未作出解释,我们还是先来看看这次的措施。

三种方式阻止GPT爬虫

那么,OpenAI都公布了哪些内容呢?

首先是GPTBot的U(ser)A(gent)信息。

User agent token: GPTBot

Full user-agent string: Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko; compatible; GPTBot/1.0; +https://openai.com/gptbot)

UA是浏览器的身份标识,包含了访问者的系统环境、浏览器内核版本、语言等诸多信息。

通过HTML的标签,可以阻止特定的浏览器对网页内容进行访问。

在这份说明文档中,OpenAI还提供了更简单的爬虫阻止方式,即修改robots.txt。

只要在网站的robots.txt中加入如下内容:

User-agent: GPTBot

Disallow: /

这样,GPTBot将不会访问你的网站进行内容抓取。

如果只想禁止GPT抓取部分内容,也可以利用robots.txt进行设置。

和上面的内容相似,分别写明允许和不允许访问的目录即可。

User-agent: GPTBot

Allow: /directory-1/

Disallow: /directory-2/

其中Allow的优先级更高,也就是说当Allow的目录是Disallow目录的子目录时,会被允许访问。

此外,OpenAI还公布了爬虫机器人的ip地址。

如果实在是对爬虫不放心,可以设置禁止有关ip对网站的访问。

什么是robots.txt

上面提到的robots.txt是什么,为什么它能阻止GPT的爬虫?

这其实是一种用户协议,站主可以在其中设置禁止访问网站的爬虫或禁止爬虫抓取的内容。

根据这一协议,即使在有能力访问的情况下,爬虫遇到相关内容都会主动选择避开。

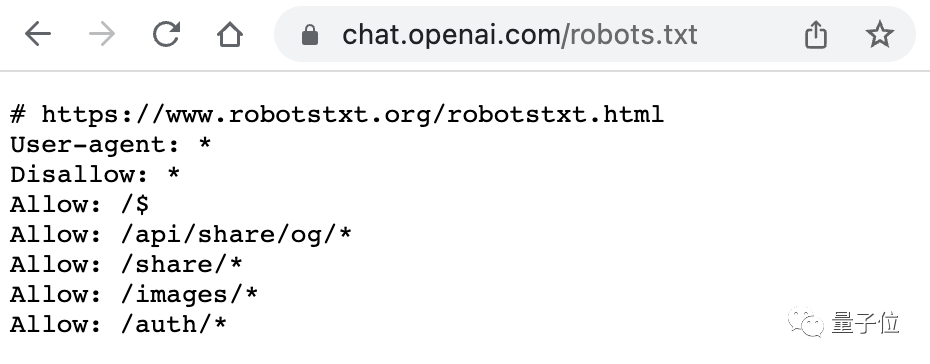

ChatGPT自身也在使用robots.txt,阻止爬虫抓取除了用户分享之外的其他内容。

其实,在AI盛行之前,这项协议就已经存在,当时主要是用于限制搜索引擎。

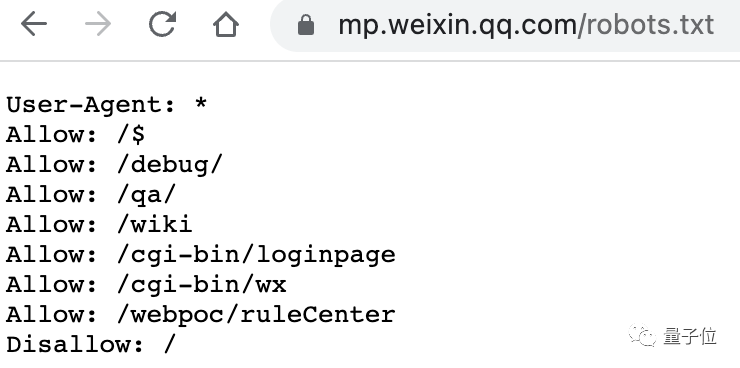

这也正是我们无法在搜索引擎中搜到微信公众号文章的原因。

这是一项君子协定,不过大多数厂商都会选择遵守,因为这体现了对行业规则和用户隐私的尊重。

如今,OpenAI也加入了这一行列。

One More Thing

与此同时,Google的爬虫正在全网抓取内容。

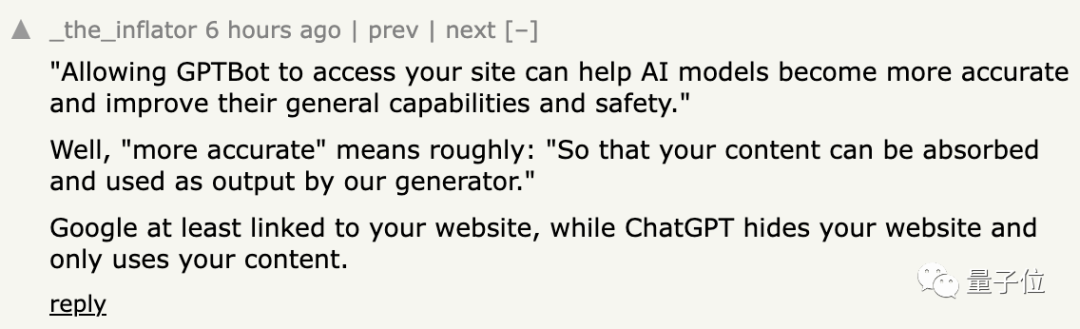

不过,网友对此似乎有更高的容忍度:

至少Google是链接到你的网站,但ChatGPT用了你的内容之后根本不会进行说明。

你认为在提高模型质量和保护创作者之间该如何找到平衡点呢?