近日,人工智能初创企业 Suno 对外发布了 Suno 模型 V3 版本,并在官网上提供了免费试用。据介绍,在 V2 版本基础上,V3 版本增加了更多音乐风格和流派,同时也加强了对提示词的依从性,减少了幻觉问题,效果更加令人惊艳。所以这款 AI 驱动的歌曲生成器在社区内迅速传播,引发了一股创作热潮。

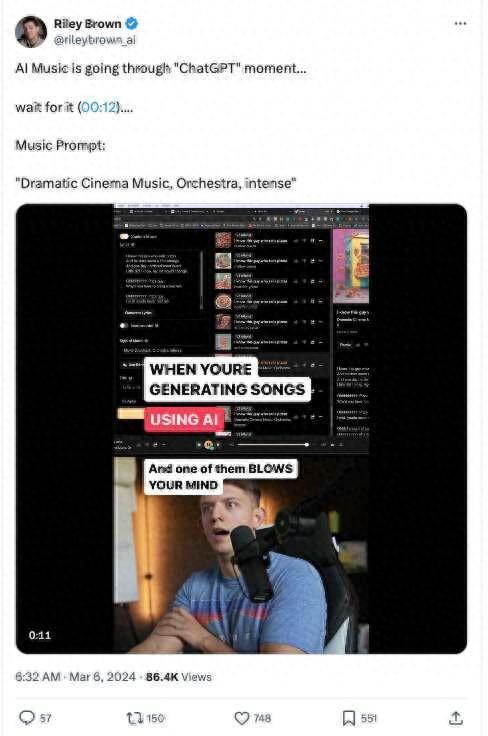

Suno 能够根据用户输入的简单文本描述,生成完整的歌曲作品,包括歌词、人声和配器等所有内容。这使得音乐创作不再局限于专业人士,即使是没有任何音乐基础的人,也能轻松创作出属于自己的歌曲。尽管 Adobe 的 Project Music GenAI、YouTube 的 Dream Track 和 Voicify AI 等 AI 音乐生成器已先行推出,但只有 Suno 脱颖而出,被誉为“音乐界的 ChatGPT”。

让 Transformer 唱起来

文本转语音(TTS)的发展历程,其底层架构的演变可以概括为共振峰合成→串联合成→神经网络。现如今,最先进的 TTS 只需调用一次 API,即可使用 Eleven Labs 和 OpenAI 的 TTS 模型或 Descript 产品。整个过程延迟极低,语调顺畅自然,甚至能够模仿各种口音。一天之内,大家就能拥有自己的语音 AI 陪聊。那有了语音陪聊 AI 的下一步是什么?当然是让它唱起来!

据报道,Suno 创业团队仅成立不到两年时间,由 Mikey Shulman、Keenan Freyberg、Georg Kucsko 和 Martin Camacho 联合创立。四人都是机器学习方面的专家,此前曾一同就职于人工智能企业 Kensho,并想打造出以财务场景为核心的语音识别工具(例如财报电话会议)。但身为音乐家兼音响发烧友,他们开始尝试将文字转语音、AI 和音频生成结合起来,最终离开 Kensho 选择全职创业。

当初创办公司时,很多人提醒我们应该专注于语音。大家都说如果想建立一家音频公司,那语音的市场空间更为广阔。但我一直觉得音乐中蕴藏着众多个性化的要素,所以总想要探索一番。于是我们总会情不自禁地构建音乐模型并加以使用,并深深为此而着迷。

他们的第一款规模产品就是 Bark,这是首个基于开源 Transformer 的“文本到音频”模型(架构受到 Karpathy NanoGPT 的启发),一个月内就在 GitHub 上从零开始获得 1.9 万颗 star。当时,他们觉得音频生成相较于文本和图像实在太过落后。而且与之前的模型不同,Bark 不仅能够生成语音,还可以输出音乐与音效,例如哭、笑和叹息等。

当时困扰他们的核心难题,就是文本到语音的训练数据极其有限。因此,他们决定从头开始构建一款新的基础模型,利用音频进行训练,之后再做微调以实现文本到语音转换。这种将音频转化为令牌来进行自监督学习的方法成为重要的创新成果。与以往适用度有限且相当不自然的 TTS 模型不同,Bark 根据来自广泛上下文的真实音频进行训练,因此输出结果可谓丝滑流利。

随着 Bark 的流行,越来越多用户开始使用它生成音乐。从实际效果来看,他们的模型架构确实能够生成人们喜爱的音乐,而且走上了一条其他研究机构相对忽视的独特道路:

大家都高度关注大语言模型,特别是其强大的信息处理与智能表现。但我觉得人们似乎忘记了事情的另一面——音乐创作,虽然这部分市场相对较小,但带给人们的感受和愉悦却是非常真实。