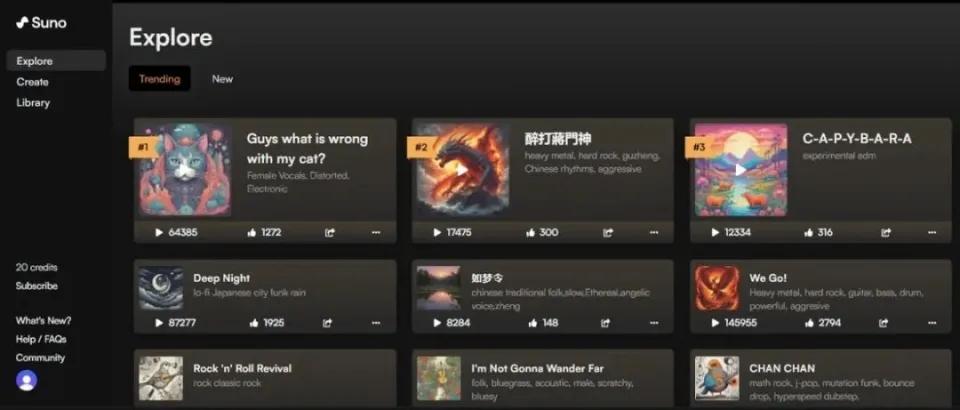

去年ChatGPT面世以来,生成式AI取代这个行业,那个行业就闹了一阵,但后来又渐渐平息。今年年初就已经涌现出一批新的AI大模型:文字生成视频的Sora、支持200万字长文本处理的Kimi,以及文生音频的新星——Suno。

它可怕在哪点呢,之前AI生成就是只有片段还不是整首,现在Suno音乐生成模型,无论用户是否拥有乐理知识,只需输入简单的提示词,比如音乐风格、音乐流派、歌词内容、音色等,等待几秒就能快速生成带有歌词和节拍的2分钟音乐。

近期Suno公司还推出了V3版本,该版本首次能够生成广播质量的音乐,并新增了更丰富的音乐风格和流派选项,比如古典音乐、爵士乐、Hiphop、电子等新潮曲风。官方表示V4版本已经在开发中,并计划推出全新功能。

这个消息一出,自然又是什么“音乐界的ChatGPT”“颠覆音乐圈”“音乐人将失业”等等,这些是无数网友和媒体评价又来了。

这个再结合现在本来就非常溃烂的华语乐坛,岂不是华语音乐最先要完蛋了?

AI音乐生成有多可怕?不至于,但确实也不可小觑

我个人还没有体验过这个软件,但是看过一些博主的视频,视频里的歌听下来,基本可以判断这个ai算法就是套和弦做旋律加离调技巧,练习样本基本都是欧美曲库。如果练习样本扩大到各个民族各种风格的音乐,只能说,靠套和弦写歌的音乐人真的吃不上饭了,音乐未来估计只容得下一流艺术家。

怎么讲呢,我们可以参考历史上汽车取代马车,相机取代绘画,影视剧取代戏剧等等行业。其实马车和汽车还不太能对比,因为这个是代步行业没有太多文化价值,后者更适合一些。你看相机,电影并没有完全取代旧有行业,但是旧有行业大大降低是肯定的。

同时在玩法上就变得高精专或者抽象,毕竟新行业(电影和流行音乐因为传播时间短),所以旧有行业的长时间玩法,还有抽象艺术是玩不过传统行业的。

它并没有完全取代,但确实占据了人们的生活,今后流行音乐更难界定抄袭。有了这套工具,独立音乐人其实可以转型成文化产品配乐,一个人一台电脑就能解决游戏,影视,甚至广播剧漫画小说的整套配乐。虽然赚的比以前少,但还算有活路。

我是一个业余音乐爱好者,同时也喜欢喜欢,我们说乐坛烂就是说都是套路,也就是通用和弦。并不指某一首曲子,也不能算得上是一类曲子的通用和弦,这个名词描述的是一种复调写作手法,重要特征为同一个主题(也可能有变化)间隔某一相同节拍叠放。

这里我能想到最好的例子是莫扎特的“品菊”,这首很明显就是一个六声部卡农,写的十分精巧。在向后发展的过程中,卡农就很少单独出现了,一般会作为插段或者发展部的开头。

我十分赞同有人所说“流行音乐是相对简单”的这个观点,事实上这和我认知到的知识层面相当一致。更深一层,我认为其根本原因是人类耳朵的构造本身不能识别过于复杂的东西。现在大家觉得AI取代音乐,偏颇在于这个模型只放在流行音乐上,而且是华语乐坛上。

这样的数据如果想要来概括“音乐”的话,还是有些管中窥豹。因为流行音乐只是音乐的一小部分。像是向古代看,马勒,斯克里亚宾这些人,向近代看,斯特拉文斯基,施尼特凯这些人,向现代看,潘德列茨基,细川俊夫等等这些人,像这样的尝试或者说研究应该能将音乐更多样的表达出来吧。

AI一出,音乐都成了套路?流行音乐确实越来越“套路了”

流行音乐的前身更像是极简主义音乐和爵士等风格的杂合体(当然这么说可能也不能完全概括),它既继承了一部分前人所探寻的东西也引入了新的观念。比如说“流量”。这一点让大众来决定了流行音乐会走向何方。

但现代派音乐这种高深的东西真的是大众不能欣赏的吗?

我认为不是,举例子就是电音的发展。电音在上世纪三四十年代出现的时候可是最先锋的一波。到了六十年代像管风琴一样大的机器出现在伯恩斯坦的指挥台旁边时他仍是新鲜玩意。但我们早已对它习以为常了。

用这种技术来创造新的合成器音色,或者用这种技术来模拟已有的音色,都是现在常用的东西。除了这些,在和声的范畴里,在流行音乐中远功能和声已然成为了家常便饭,这也是先前古典时期或者更早巴洛克时期没有的东西。

所以我想,现代派音乐中丰富的技巧会成为流行音乐发展的一部分的。我作为青年也是有想要将我的想法更多的与别人交流的想法的。在这些想法中也不乏批判性的。不论正确与否,这些想法都会是有意义有价值的。

我们所谓的套路和弦,也就是平均歌的评价标准只是歌曲评价标准的一部分,也就是用户期望违背模型——越贴近平均歌,代表着这首歌更满足用户的期望,用户越能猜到这首歌接下来会唱什么,这是双刃剑。

用户能猜到接下来的旋律,代表这首歌落入俗套,但歌曲不满足听众期望也不是好事。

所以这个AI模型往往和信息熵结合起来,也就是期望违背-信息熵模型。2016年Eerola在《Expectancy-Violation and Information-Theoretic Models of Melodic Complexity》论文里面就提出这种模型。