当下,全球人工智能(AI)一日千里,在历史的进程里极速狂奔。出激动人心的时刻一波接着一波。

11月7日,宇宙最红AI公司Open AI举办首届开发者大会,吸引令全球科技界的关注。Open AI不仅发布了多项技术升级,更是外露了打造生态的野心:构建GPTStore,走向“苹果化”。

Open AI创始人Sam Altman在开发者大会演讲

11月4日,宇宙最红企业家马斯克旗下xAI团队发布了首个AI大模型产品Grok。马斯克称表示,xAI的宏大目标是了解宇宙到底发生了什么,且一定会与OpenAI展开竞争。

在10月31日开幕的云栖大会上,人工智能、大模型、云计算同样是超级话题。在这次大会上,阿里巴巴新任董事局主席蔡崇信宣布了一件对业界影响重大的事:阿里巴巴要打造AI时代最开放的云。

蔡崇信表示,开放是希望让大家开发AI、使用AI变得更加容易和便宜,帮助各行业,特别是中小企业把AI转化为生产力。

换句话说,在大模型时代,阿里云要做的不是端到端的超级应用,而是回归公有云,扮演“水电煤”的角色,做AI 时代的基础设施。

8年前的云栖大会上,阿里巴巴董事局主席马云发表了激情澎湃的演讲。他当时说,阿里云的整个思想,就是把阿里巴巴积累的数据、计算能力以及云的一切,分享给无数追梦者、无数创业者,能够让他们梦想成真。

那时,国内移动互联网发展日新月异,阿里云已是国内最大的云计算平台,重塑了开发者获取计算资源的方式。

但他们有更大的野心:向金融、生命科学、新能源等更多领域拓展,成为更多领域创新、提效的基础设施。

图注:2015年,阿里云首次启动大规模广告,新的品牌广告在各大机场上线。

彼时,阿里巴巴刚在美国上市不久,它不想局限于做一家电商平台,其业务版图逐渐拓宽至文娱、云计算、人工智能等。阿里云的财务数据在2015年首次出现在阿里的财报中。在资本市场,阿里云一度代表的是阿里巴巴第二增长曲线。

今年的云栖大会有点“梦回2015”的意思,阿里云不仅再提开放,就连大会主题都用了2015年的同款——“计算,为了无法计算的价值”。

当然,阿里云也期待通过开放和生态,在AI时代再造高增长。

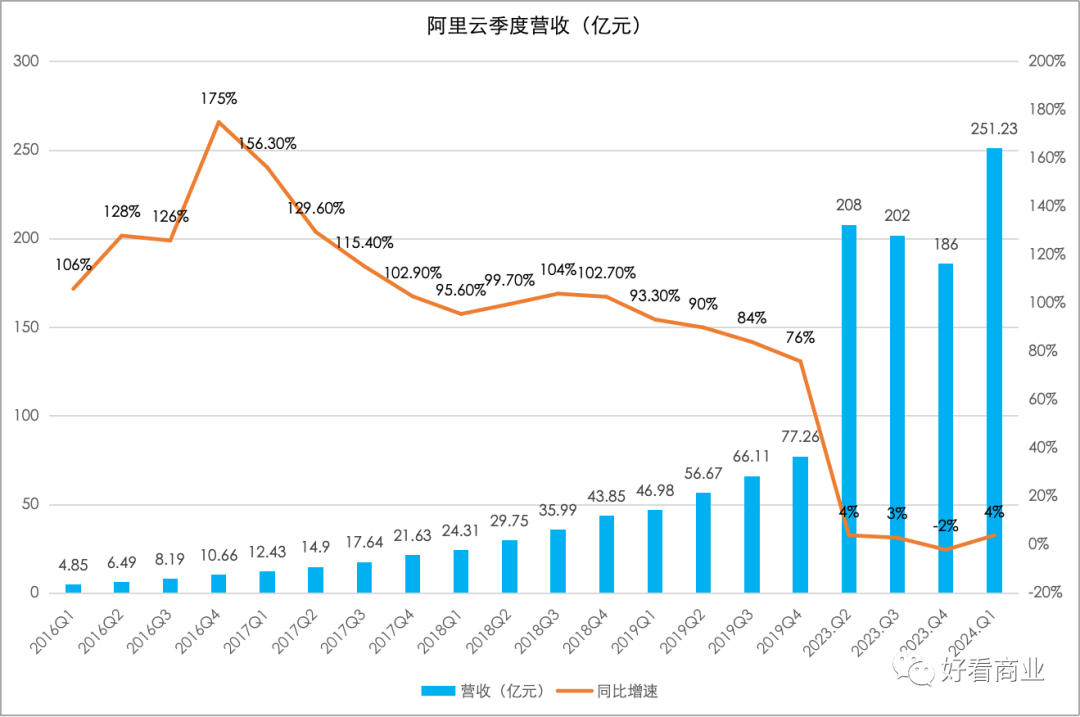

就在马云振臂高呼,宣布“分享阿里云的一切”之后,阿里云持续吃到了“开放”带来的红利——营收连续12个季度翻倍增长;长期以近50%的份额在国内公有云市场排第一。

图注:阿里财报中,2016财年Q1对应自然年2015年Q2,以此类推。

但从2019财年Q1起,阿里云的增长神话开始褪色,之后就进入了持续放缓的周期。近几个季度,阿里云营收增速维持在个位数。

背后是行业大势变了。上云需求从移动互联网逐渐向政企市场切换,加上疫情等因素,国内互联网云厂商都慢了下来。

2023年,大模型的爆发让人工智能与云计算历史性地结合在一起,也为算力体系带来重构和创新的历史机遇。阿里云创始人王坚将这次结合视为云计算的第三次浪潮。

作为国内收入规模和市场份额最大的云厂商,阿里云显然希望再次抓住时代的大势,继续领先。

苏格拉底说,人不能两次踏进同一条河流。阿里云却要在“计算”这条大河里,再次抓住历史机遇。这并非易事,它注定要面对不同的挑战,克服不同的难题。

“不开放就没有未来”

今年以来,ChatGPT引爆了大模型,中国市场更是上演“百模大战”。

据北京市经济和信息化局的数据,截至今年10月,仅北京市就有百余款大模型产品,占全国总量的一半左右。意味着,国内大模型已经超过200个。

截至目前,国内有头有脸的互联网/科技公司、有名气的创业者都推出了自家的大模型。百度和阿里云属于先行者。3月份,百度在全球互联网大厂中首个发布大模型产品文心一言;一个月后,阿里云推出通义千问大模型。

在当时的发布会上,阿里云CTO周靖人说,所有软件都值得接入大模型升级改造,阿里将开放通义千问的能力,帮助每家企业打造自己的专属大模型。

但大模型到目前仍处在初级阶段,一个基础模型要真正用到实际场景里,还需要很多二次开发,结合领域知识才能解决具体领域的问题。

从需求端看,企业通过自研或者与第三方模型服务商合作,打造一个主力模型。同时,在主力模型之外,通常还会采用多个外部模型,应用于不同的场景。

总得来说,需求端对模型的需求是多元的,采用的第三方模型不会只限于一家。阿里云魔搭社区的数据也能作证这一点。魔搭上线一年,就汇聚了聚了280万开发者,2300多个优质模型,模型下载量超过1亿。

这意味着,云厂商很难通过自研大模型的方式满足需求的大多数,也很难形成垄断。但作为云厂商,客户又对阿里云提出了更多要求。

周靖人近期接受《晚点LatePost》采访时提到,他们最开始做大模型时,想把几百台服务器连起来做训练,但很难,他们需要把云团队与模型团队紧密配合,云优化一点,大模型进步一点,如此往复、交替往前走。

因此他们判断:并不是把足够多的GPU连起来就能支撑大模型的发展,AI 和云是不可分割的整体;推动模型进步需要对云的各层级的技术做升级和创新。

截至目前,全国80%的科技企业和超过一半的AI大模型公司都跑在阿里云上,他们的需求是多种多样的。

例如百川智能这样的客户,他们能开发通用模型,需要的是 AI 基础设施。朗新科技、央视网、亚信科技这样的客户,他们的需求是基于通用模型,结合自身数据和行业知识开发专属大模型。也有童话故事、供春AI这样的创业公司,他们直接调用阿里云的大模型,以最低的IT成本创业。

客户的多样化需求阿里云对分布式框架设计、服务器设计、网络、存储、机器学习框架等诸多方面进行升级、重构,帮助客户训练好大模型、用好大模型。

作为AI基础设施,只有形成更繁荣的生态,让市场上有更多更好的模型和应用,算力需求才能更大,阿里云才能最终受益。

开源、社区是现阶段助力AI生态繁荣的重要途径,蔡崇信甚至在致辞中强调,“没有开放就没有生态,没有生态就没有未来”。

的确,开源可以让更多模型开发者和企业免费调用模型,以更低的成本加快模型的开发和落地。社区是开发者交流的平台,帮助中国开发者降低模型的使用门槛,同时在社区上线的开源模型也可以在这里及时获得反馈,不断优化、升级。

也因此,阿里云成为国内最早开源自研大模型的科技公司。目前,阿里云已开源通义千问7B、14B版本,下载量突破百万。通义千问72B模型也即将开源,它将成为中国参数最大的开源模型。

为推动AI生态繁荣,这次云栖大会上,阿里云还宣布了“云工开物”计划,要给每个想尝试 AI 前沿技术的高校学生提供全年 300 元的阿里云产品免费额度。这相当于给每个学生配备了一台云服务器。

AI基础设施怎么做?

把通义千问大模型开源,供业界免费使用,这是阿里云打造开放生态的其中一环。截至目前,阿里云已初步建成AI时代全栈的云计算体系。

具体来看,主要包括四个大的部分:

其一,高性能分布式模型训练平台——PAI灵骏。为保证大模型训练的稳定互联和高效并行计算,近期阿里云全新升级了PAI灵骏,底层采用HPN 7.0新一代AI集群网络架构,可支持高达10万卡量级的集群可扩展规模,超大规模分布式训练加速比高达96%。

其二,低延时模型推理与服务平台——PAI灵积。它可以为其他模型厂商提供API接口,并提供推理服务。

据阿里云披露的数据,目前其提供的AI基础设施可帮助企业在大模型训练中节省50%的算力资源,将大模型的训练效率提升10倍,推理效率提升2倍以上。

截至目前,中国众多主流大模型都已通过阿里云对外提供API服务,包括通义系列、Baichuan系列、智谱AI ChatGLM系列、姜子牙通用大模型等。

Baichuan系列出自大模型创业公司百川智能。百川成立仅半年时间就发布了7款大模型,平均每月迭代一款模型。

百川智能创始人兼CEO王小川表示,模型快速迭代和部署离不开云计算,百川智能与阿里云在模型预训练和模型部署等方面都进行了深入合作。在双方共同努力下,百川很好地完成了千卡大模型训练任务,并有效降低了模型推理成本,提升了模型部署效率。

其三,在模型层,阿里云不仅发布了千亿级参数规模的大模型通义千问2.0,同时发布了一系列行业模型。此前,70亿、140亿参数的通义千问模型已开源,720 亿参数的版本在11月份开源。