从昨天开始,用户开始频繁报告 ChatGPT 出现断连,甚至胡言乱语。不过用户似乎也并不那么大惊小怪了,因为这已经不知道是第多少次出现这种情况。

上一次出现大规模全球范围内瘫痪情况是在 5 月份,当时该服务在多个小时内无法访问。

不过这一次可能是最严重的一次,不仅波及到 ChatGPT、GPT4 等广泛服务,甚至还有 API 服务,这些服务出现了很高的错误率,已经影响到使用 OpenAI API 构建服务的开发者,导致他们的服务无法正常使用。

根据数据显示,在不到一年的时间里,OpenAI 周活跃用户数量就达到了 1 亿,超过 200 万开发人员在 OpenAI 的 API 服务上进行开发。

OpenAI 首席技术官 Mira Murati 本周一表示,超过 92% 的财富 500 强公司使用该平台,高于 8 月份的 80%,涉及金融服务、法律应用和教育等行业。

这次服务中断是在周一 OpenAI 宣布将对其 API 和 ChatGPT 服务进行改进并推出新功能之后发生的。

OpenAI 在本周宣布多项产品更新,推出了一种新的、更便宜的 GPT-4 Turbo 模型,具有“128K 上下文,并且比 GPT-4 具有更新鲜的知识”,可供所有开发人员预览。GPT-4 Turbo 还为所有开发人员添加了 Vision、DALL·E 3 和文本转语音功能,该公司还宣布将 GPT-4 速率限制提高了一倍。

OpenAI 表示:“为了帮助您扩展应用程序,我们将所有付费 GPT-4 客户的每分钟token限制增加了一倍。”

此外,OpenAI 还推出了定制版 GPT、助手API以及应用商店GPT Store等核心产品。

更强的性能,更便宜的使用成本,这吸引了百万用户去尝试体验,服务流量需求的暴增显而易见,但 OpenAI 显然没有为此做好准备。

从 11 月 8 日起,这些服务一度出现长达 90 分钟的中断,OpenAI 当时表示已经找到问题并实施了措施,之后服务逐渐恢复。

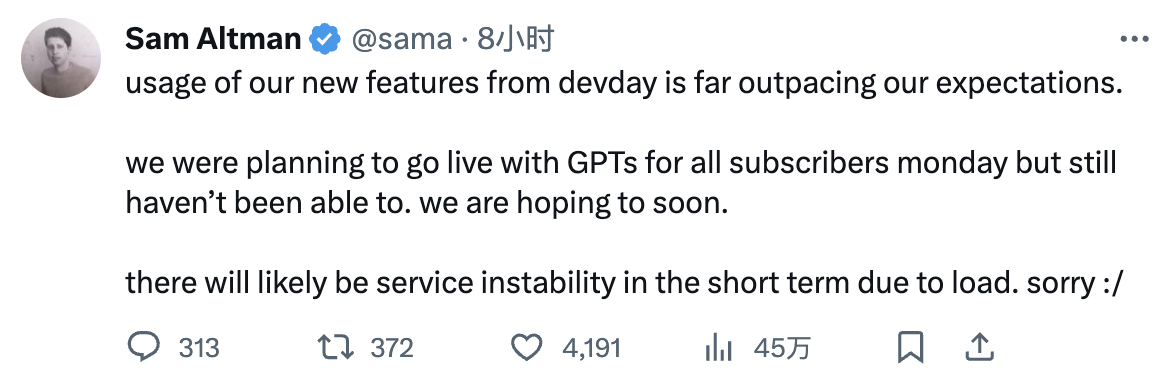

新服务超预期,用的人太多

虽然 OpenAI 并未公布出现断连的具体原因,但 Sam Altman 回应称,其开发者大会上新功能的使用“远远超出了我们的预期”,并警告称,未来可能会出现更多问题。 “由于负载的原因,短期内可能会出现服务不稳定的情况。”

11 月 9 日,OpenAI 宣布 ChatGPT和API出现周期性中断。

如此频繁出现服务中断,要么是 OpenAI 的硬件设备跟不上软件的发展速度,要么是软件服务本身存在不足。

值得注意的是,由前 OpenAI 员工创建的 ChatGPT 竞争对手 Anthropic 的 Claude 2 聊天机器人在周三也遇到了问题。 用户使用时出现错误提示:“由于意外容量限制,Claude无法回复您的消息。”不知道两起事件有没有关联。

随着 OpenAI 用户规模不断扩大,这类服务中断所造成的恶性影响会更加严重,OpenAI需要做出更多努力来阻止这种问题。